3'10" 읽기

- 보다 자율적이고 자기 인식적인 기계 개발의 발전

- 기계는 2cm 미만의 정확도로 작업을 수행

- 인간에 비해 사소하지만 어딘가에서 시작해야 한다.

- 위험을 최소화하면서 이익을 얻을 수 있어야

자신의 신체에 대한 인식이 항상 100% 현실적이지는 않다. 그런데도 세상에서 자신의 길을 찾는 데 중요한 정보다. 우리가 달리거나 공을 던질 때, 뇌는 몸이 어떤 움직임에 따라 어떻게 변할지 예상하여, 예를 들어 넘어지지 않도록 한다. 사람들은 어렸을 때 자신의 몸을 조금씩 알아가는 반면에 로봇은 지금까지 주변 세계를 인식하는 데 더 중점을 두었다.

자기 성찰을 위한 다섯 대의 카메라

뉴욕 컬럼비아 대학의 보위안 첸(Boyuan Chen)이 이끄는 팀은 이제 로봇이 일종의 신체 인식을 개발할 수 있도록 했다. "우리 인간은 자신에 대해 명확한 이해를 가지고 있다"며 “예를 들어 팔을 뻗거나 뒤로 한 발짝 내딛는다면 눈을 감고 몸이 움직이는 것을 상상할 수 있다. 우리 뇌 어딘가에는 우리가 어떤 공간을 차지하고 있으며 우리가 움직일 때 그 공간이 어떻게 변하는지 알려주는 모델인 자의식이 있다”라고 첸은 말했다.

과학자들의 목표는 로봇 팔에도 그러한 자아상을 확립하는 것이었다. 이를 위해 연구원들은 로봇을 주변에 배치된 다섯 대의 카메라에 연결하여 로봇이 자신을 관찰할 수 있도록 했다. 그런 다음 로봇은 몸 모양과 움직임 옵션을 분석하기 위해 총 3시간 동안 무작위 움직임을 수행했다. 그는 거의 8천 개의 데이터 포인트를 수집할 수 있었고 그의 신경망은 이를 사용해 운동과 운동이 차지하는 공간 사이의 연결을 학습할 수 있었다.

"부드럽게 흔들리는 구름의 일종“

"저희는 로봇이 스스로를 어떻게 상상하는지 정말 궁금했다"라고 Columbia 대학의 Hod Lipson이 말했다. "하지만 신경망은 단순히 들여다볼 수 없고 블랙박스다." 그러나 과학자들은 다양한 시도 끝에 로봇 팔의 자기 이미지를 시각화하는 데 성공했다.

"그것은 로봇의 3차원 몸을 감싸는 것처럼 보이는 부드럽게 반짝이는 구름의 일종이었다"라고 Lipson은 설명했다. "로봇이 움직일 때 깜박이는 구름이 부드럽게 따라온다." 연구원들에 따르면 이 모델의 정확도는 작업 범위의 1% 이내였다.

97% 성공률

또 다른 실험은 이러한 형태의 자기 인식 및 자기 평가의 이점을 보여주었다. 여기에서 로봇은 새로 획득한 자기 인식을 사용하여 우주에 떠 있는 공을 터치해야 한다. 처음에는 어떻게든 팔 끝으로 터치해야 한다. 이 기계는 2cm 미만의 정확도로 작업을 수행할 수 있었으며 계산에는 약 5초가 소요되었다.

세 번째 과제로 로봇은 공을 향해 가는 도중에 만지면 안 되는 큐브도 제시했다.

"전반적으로 우리 로봇은 이 작업에서 97%의 성공률을 달성했다"라고 연구원들은 보고했다. 이것은 자가 평가 능력이 그러한 움직임에서 로봇의 정확성을 촉진한다는 것을 암시할 수 있다.

자율 기계를 향한 발걸음

Hod Lipson은 팀의 작업을 자율 기계를 향한 중요한 단계로 보고 있다. "자기 모델링은 자기 인식의 원시적 형태다"라고 과학자는 설명한다. "로봇, 동물 또는 인간이 정확한 자기 모델을 가질 때 세상에서 더 잘 기능하고 더 나은 결정을 내릴 수 있으므로 진화론적 이점이 있다.“

로봇은 자신의 신체를 정확하게 인식할 수 있기 때문에 미래의 엔지니어링 작업을 절약할 수도 있다. 예를 들어, 손상이나 마모를 스스로 결정할 수도 있다. 과학자들에 따르면 이것은 자율 시스템이 훨씬 더 독립적이 되기 위한 중요한 단계다. 예를 들어, 생산 로봇은 이를 사용하여 특정 부품이 제대로 작동하지 않을 때를 확인하고 오류 자체를 수정하거나 도움을 요청할 수 있다.

"인간에 비하면 하찮지만“

그들의 연구에서 연구원들은 로봇에 대한 더 큰 자율성과 개인적 책임이 논란의 여지가 있는 주제이며 위험을 수반할 수 있음을 잘 알고 있다. Lipson에 따르면 지금까지 개발된 자기 인식은 "인간에 비해 사소하지만 어딘가에서 시작해야 한다. 위험을 최소화하면서 이익을 얻을 수 있도록 천천히 조심스럽게 나아가야 한다.”

(Science Robotics, 2022; doi:10.1126/scirobotics.abn1944)

출처: Columbia University School of Engineering and Applied Science

- 보다 자율적이고 자기 인식적인 기계 개발의 발전

- 기계는 2cm 미만의 정확도로 작업을 수행

- 인간에 비해 사소하지만 어딘가에서 시작해야 한다.

- 위험을 최소화하면서 이익을 얻을 수 있어야

로봇이 자신의 몸을 인식한다.

학습할 수 있는 기계는 일종의 자기 인식 및 자기 평가를 개발한다.

과학자들이 자의식을 가진 로봇을 개발했다. 학습이 가능한 기계는 여러 대의 카메라를 통해 스스로를 관찰하고 모양과 움직임에 대한 모델을 독자적으로 개발했다. 이것은 연구원들에게 간단한 형태의 자기 평가를 제공했으며, 과제에서 유용하다고 생각했습니다. 이것은 연구원들이 Science Robotics 저널에 보고한 바와 같이 보다 자율적이고 자기 인식적인 기계의 개발을 발전시킬 수 있다.

|

| ▲ 이 로봇 팔은 자신의 모양을 인지할 수 있다. 그래서 그는 공을 만지지만 큐브는 만지지 않는다. © Jane Nisselson 및 Yinuo Qin / Columbia Engineering |

자신의 신체에 대한 인식이 항상 100% 현실적이지는 않다. 그런데도 세상에서 자신의 길을 찾는 데 중요한 정보다. 우리가 달리거나 공을 던질 때, 뇌는 몸이 어떤 움직임에 따라 어떻게 변할지 예상하여, 예를 들어 넘어지지 않도록 한다. 사람들은 어렸을 때 자신의 몸을 조금씩 알아가는 반면에 로봇은 지금까지 주변 세계를 인식하는 데 더 중점을 두었다.

자기 성찰을 위한 다섯 대의 카메라

뉴욕 컬럼비아 대학의 보위안 첸(Boyuan Chen)이 이끄는 팀은 이제 로봇이 일종의 신체 인식을 개발할 수 있도록 했다. "우리 인간은 자신에 대해 명확한 이해를 가지고 있다"며 “예를 들어 팔을 뻗거나 뒤로 한 발짝 내딛는다면 눈을 감고 몸이 움직이는 것을 상상할 수 있다. 우리 뇌 어딘가에는 우리가 어떤 공간을 차지하고 있으며 우리가 움직일 때 그 공간이 어떻게 변하는지 알려주는 모델인 자의식이 있다”라고 첸은 말했다.

과학자들의 목표는 로봇 팔에도 그러한 자아상을 확립하는 것이었다. 이를 위해 연구원들은 로봇을 주변에 배치된 다섯 대의 카메라에 연결하여 로봇이 자신을 관찰할 수 있도록 했다. 그런 다음 로봇은 몸 모양과 움직임 옵션을 분석하기 위해 총 3시간 동안 무작위 움직임을 수행했다. 그는 거의 8천 개의 데이터 포인트를 수집할 수 있었고 그의 신경망은 이를 사용해 운동과 운동이 차지하는 공간 사이의 연결을 학습할 수 있었다.

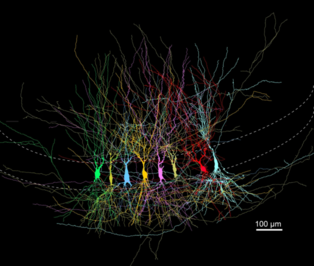

| ▲ 그림 1. 시각적 자가 모델링 로봇. 우리는 로봇에게 시각적 자체 모델로 알려진 관절 각도만 주어진 3D 공간에서 전체 형태와 운동학을 모델링할 수 있는 기능을 갖추고 있다. 시각적 자체 모델을 통해 로봇은 자신과 3D 세계 간의 잠재적인 상호 작용을 시뮬레이션하여 다양한 동작 계획 및 제어 작업을 수행할 수 있다. 우리의 시각적 자기 모델은 연속적이고, 메모리 효율적이며, 미분 가능하고, 운동학적 인식이다. (출처: 관련논문 Fully body visual self-modeling of robot morphologies / Science Robotics) |

"부드럽게 흔들리는 구름의 일종“

"저희는 로봇이 스스로를 어떻게 상상하는지 정말 궁금했다"라고 Columbia 대학의 Hod Lipson이 말했다. "하지만 신경망은 단순히 들여다볼 수 없고 블랙박스다." 그러나 과학자들은 다양한 시도 끝에 로봇 팔의 자기 이미지를 시각화하는 데 성공했다.

"그것은 로봇의 3차원 몸을 감싸는 것처럼 보이는 부드럽게 반짝이는 구름의 일종이었다"라고 Lipson은 설명했다. "로봇이 움직일 때 깜박이는 구름이 부드럽게 따라온다." 연구원들에 따르면 이 모델의 정확도는 작업 범위의 1% 이내였다.

97% 성공률

또 다른 실험은 이러한 형태의 자기 인식 및 자기 평가의 이점을 보여주었다. 여기에서 로봇은 새로 획득한 자기 인식을 사용하여 우주에 떠 있는 공을 터치해야 한다. 처음에는 어떻게든 팔 끝으로 터치해야 한다. 이 기계는 2cm 미만의 정확도로 작업을 수행할 수 있었으며 계산에는 약 5초가 소요되었다.

세 번째 과제로 로봇은 공을 향해 가는 도중에 만지면 안 되는 큐브도 제시했다.

"전반적으로 우리 로봇은 이 작업에서 97%의 성공률을 달성했다"라고 연구원들은 보고했다. 이것은 자가 평가 능력이 그러한 움직임에서 로봇의 정확성을 촉진한다는 것을 암시할 수 있다.

자율 기계를 향한 발걸음

Hod Lipson은 팀의 작업을 자율 기계를 향한 중요한 단계로 보고 있다. "자기 모델링은 자기 인식의 원시적 형태다"라고 과학자는 설명한다. "로봇, 동물 또는 인간이 정확한 자기 모델을 가질 때 세상에서 더 잘 기능하고 더 나은 결정을 내릴 수 있으므로 진화론적 이점이 있다.“

로봇은 자신의 신체를 정확하게 인식할 수 있기 때문에 미래의 엔지니어링 작업을 절약할 수도 있다. 예를 들어, 손상이나 마모를 스스로 결정할 수도 있다. 과학자들에 따르면 이것은 자율 시스템이 훨씬 더 독립적이 되기 위한 중요한 단계다. 예를 들어, 생산 로봇은 이를 사용하여 특정 부품이 제대로 작동하지 않을 때를 확인하고 오류 자체를 수정하거나 도움을 요청할 수 있다.

"인간에 비하면 하찮지만“

그들의 연구에서 연구원들은 로봇에 대한 더 큰 자율성과 개인적 책임이 논란의 여지가 있는 주제이며 위험을 수반할 수 있음을 잘 알고 있다. Lipson에 따르면 지금까지 개발된 자기 인식은 "인간에 비해 사소하지만 어딘가에서 시작해야 한다. 위험을 최소화하면서 이익을 얻을 수 있도록 천천히 조심스럽게 나아가야 한다.”

(Science Robotics, 2022; doi:10.1126/scirobotics.abn1944)

출처: Columbia University School of Engineering and Applied Science

[더사이언스플러스=문광주 기자]

[저작권자ⓒ the SCIENCE plus. 무단전재-재배포 금지]

주요기사

+

많이 본 기사

Basic Science

+

AI & Tech

+

Photos

+